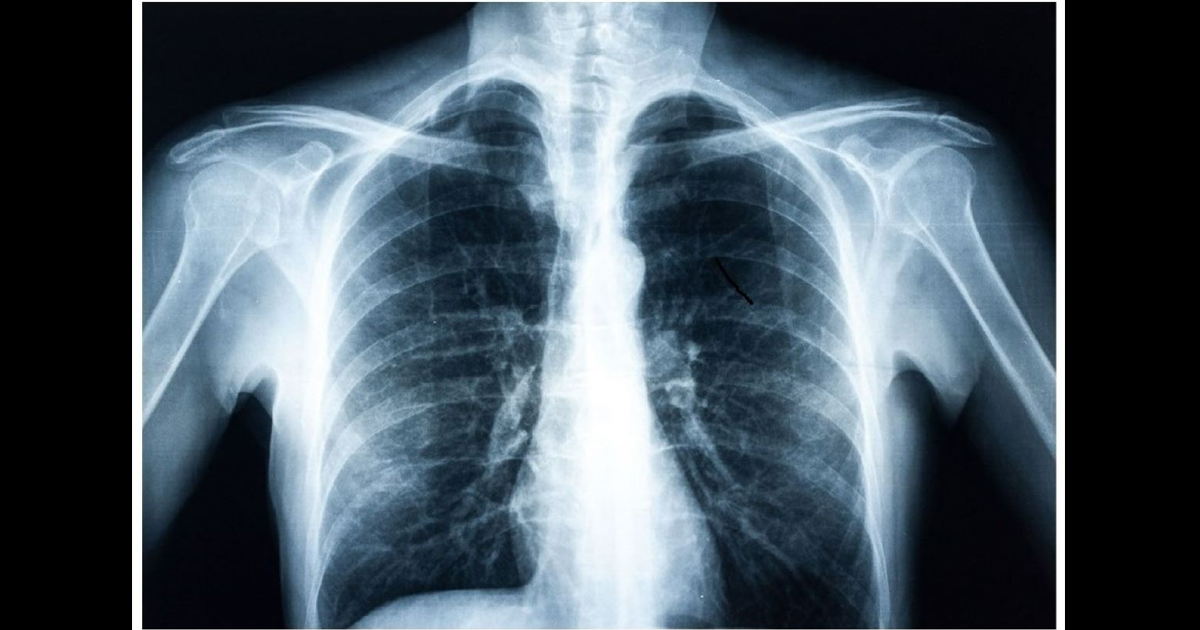

Científicos de la Escuela de Medicina de Harvard (HMS) y de la Universidad de Stanford, desarrollaron una herramienta de diagnóstico basada en Inteligencia Artificial (IA), para la detección de enfermedades analizando imágenes de rayos X del tórax.

La Universidad de Harvard, detalla que esta solución supera un obstáculo en el diseño de IA clínica, ya que puede detectar enfermedades en radiografías de tórax, a partir de descripciones en lenguaje natural contenidas en informes clínicos. La mayor parte de los modelos de IA necesitan una gran cantidad de anotaciones clínica realizadas por especialistas, estos datos deben ser etiquetados y posteriormente introducidas al modelo de IA para su entrenamiento.

El reporte de estos avances fue publicado en Nature Biomedical Engineering. El artículo detalla que ro, como fue denominado el modelo, desempeñó sus tareas a la par de los radiólogos humanos en la capacidad para la detección de patologías en radiografías de tórax.

El proceso más común para el entrenamiento de modelos de IA es el etiquetado de conjuntos de datos. De esta forma el modelo aprende a identificar patologías específicas. Sin embargo, este proceso requiere una cantidad masiva de anotaciones médicas, lo cual además de requerir mucho tiempo es costoso.

Es decir, para etiquetar conjuntos de radiografías de tórax, los radiólogos deben observar miles de imágenes y realizar anotaciones manualmente sobre cada una. En cambio, este modelo es auto supervisado y aprende de manera independiente sin la necesidad de contar con datos etiquetados a mano. El modelo analiza por sí mismo las anotaciones que se encuentran en informes de radiografías. No obstante, una de sus limitantes es que solo identifica notas escritas en inglés.

“Estamos viviendo los primeros días de los modelos médicos de IA de próxima generación que pueden realizar tareas flexibles aprendiendo directamente del texto”, dijo el investigador principal del estudio, Pranav Rajpurkar, profesor asistente de informática biomédica en el Instituto Blavatnik en HMS.

CheXZero, facilita la alimentación del modelo y el aprendizaje, ya que puede aprender conceptos en textos no estructurados y relacionarlo con patrones visuales en las imágenes médicas. El entrenamiento del modelo fue realizado con más de 377 mil radiografías de tórax y más de 227 mil notas clínicas adjuntas. Posteriormente para evaluar y probar su desempeño fue aplicado en dos conjuntos de datos separados. La prueba identificó éxito en el diagnóstico de patologías que no fueron anotadas por los médicos, lo que supera a otras herramientas de IA auto supervisadas.

Por último, los científicos detallaron que el modelo puede aplicarse a otras modalidades de imágenes médicas como tomografías computarizadas, ecocardiogramas o resonancias magnéticas.

Otro aspecto importante de esta investigación es que los autores han hecho público el modelo utilizado: https://github.com/rajpurkarlab/CheXzero. Asimismo, puedes consultar el estudio completo en el siguiente enlace: https://www.nature.com/articles/s41551-022-00936-9