El estudio detalla que los usuarios de neuroprótesis con BCI pueden participar activamente en una conversación con otras personas.

Investigadores de UC Davis desarrollaron una investigación sobre una interfaz cerebro-computadora (BCI, en inglés) que presenta un nuevo avance en neurotecnología ya que permite convertir directamente la actividad cerebral en voz hablada en tiempo real. Esta tecnología está diseñada para personas que han perdido la capacidad de hablar debido a enfermedades neurológicas como la esclerosis lateral amiotrófica (ELA).

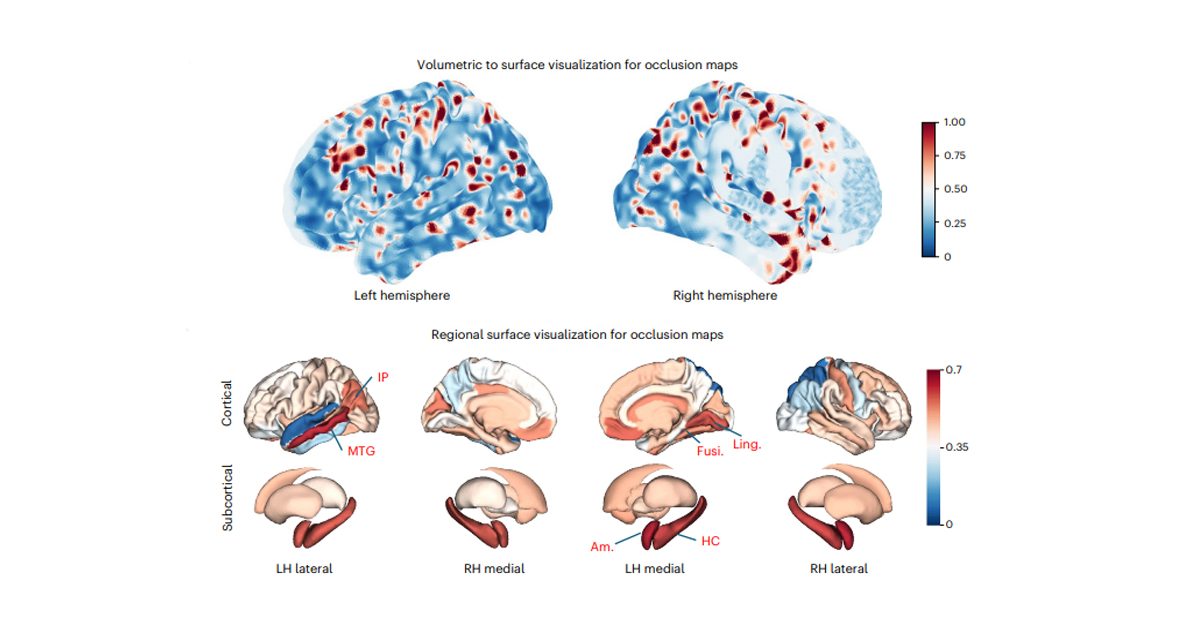

En este estudio, publicado en Nature, un hombre con ELA y disartria severa (dificultad para articular palabras), participante del ensayo clínico BrainGate2, fue implantado con 256 microelectrodos en el giro precentral ventral, una región del cerebro relacionada con la producción del habla. Gracias a esta interfaz, pudo sintetizar su voz de manera inmediata y recibir retroalimentación auditiva, es decir oír su propia voz generada por el sistema.

“Traducir la actividad neuronal en texto, que es como funciona nuestra anterior interfaz cerebro-ordenador de voz, es parecido a los mensajes de texto. Es una gran mejora en comparación con las tecnologías de asistencia estándar, pero sigue retrasando la conversación. En comparación, esta nueva síntesis de voz en tiempo real es más parecida a una llamada de voz”, detalla Sergey Stavisky, autor principal del artículo y profesor adjunto del Departamento de Cirugía Neurológica de UC Davis. Stavisky detalla que la síntesis de vos instantánea, los usuarios de neuroprótesis pueden participar activamente en una conversación con otras personas.

A diferencia de otros sistemas que solo traducen la intención del habla a texto escrito, esta neuroprótesis logra reproducir sonidos de la voz humana, incluyendo no solo las palabras, sino también aspectos expresivos como la entonación y la capacidad de cantar pequeñas melodías. Según detalla el estudio, el sistema logró entrenarse sin ejemplos directos de la voz del paciente, lo cual representa un gran avance técnico.

“El principal obstáculo para sintetizar la voz en tiempo real era no saber exactamente cuándo y cómo intenta hablar la persona con pérdida del habla”, explica Maitreyee Wairagkar, primera autora del estudio y científica del proyecto en el Laboratorio de Neuroprótesis de la UC Davis. “Nuestros algoritmos asignan la actividad neuronal a los sonidos previstos en cada momento. Esto permite sintetizar matices en el habla y dar al participante el control sobre la cadencia de su voz BCI”.

La BCI fue capaz de traducir las señales neutrales del participante en voz audible y reducida a través de un altavoz con gran rapidez. Asimismo, la tecnología permitió al participante decir palabras que el sistema aún no conocía y hacer interjecciones. La modulación de la voz generada por computadora para realizar preguntas o enfatizar palabras en una oración fueron otros de los hallazgos del estudio.

Cabe destacar que la voz sintetizada por la BCI suele ser inteligible, los oyentes pudieron entender de manera correcta casi el 60% de las palabras a diferencia del 4% cuando el paciente no contaba con la BCI.

Los electrodos midieron los patrones de activación de cientos de neuronas, posteriormente los investigadores alinearon estos patrones con los sonidos del habla que el participante intentaba producir en ese momento. De esta forma, el algoritmo logró reconstruir con precisión la voz del participante utilizando solamente sus señales neuronales.

“Nuestra voz es parte de lo que nos define como personas. Perder la capacidad de hablar es devastador para las personas que viven con afecciones neurológicas”, afirmó David Brandman, codirector del Laboratorio de Neuroprótesis de UC Davis y neurocirujano que realizó el implante del participante.

Los resultados de la investigación muestran la capacidad transformadora de los BCI y las neuroprótesis. Sin embargo, existen limitaciones importantes, en primer lugar debido a que esta clase de tecnología emergente se encuentra en fase inicial. En segundo lugar, que la investigación tomó en cuenta solo a un participante con ELA, por lo que será fundamental que a futuro se repliquen estos resultados con más participantes, que permitieron el habla por otras causas, para confirmar el potencial de la tecnología.