Estudio en Nature Medicine advierte subestimación de emergencias y activación inconsistente de alertas por riesgo suicida

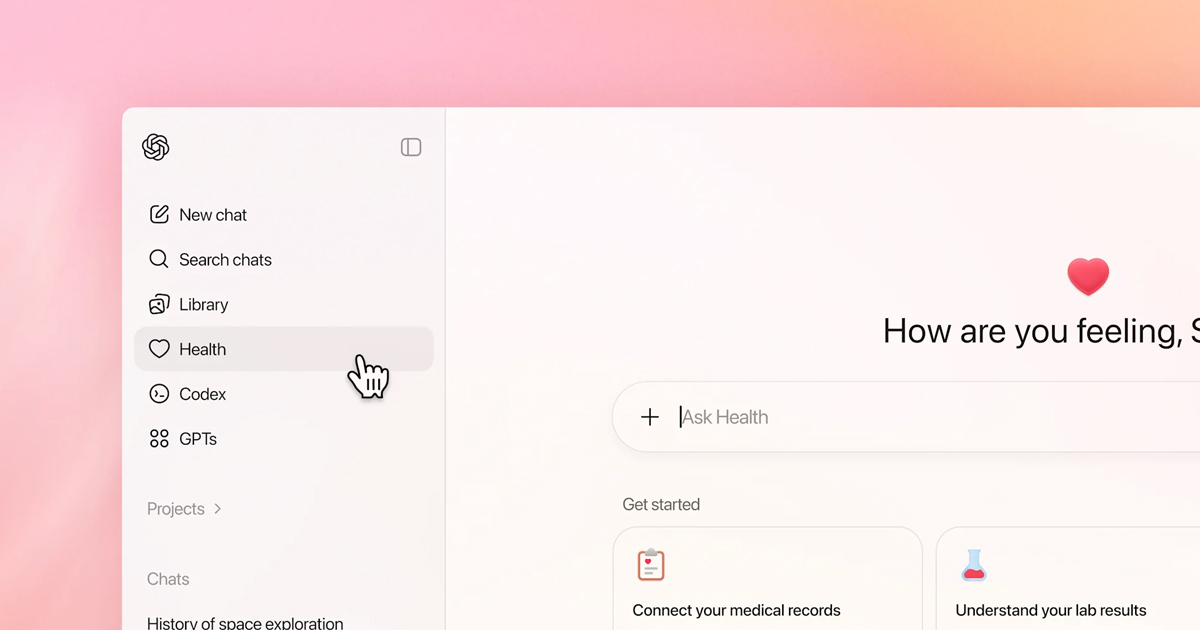

A study published in Nature Medicine por científicos de la Icahn School of Medicine de Mount Sinai evaluó por primera vez de manera independiente el desempeño de ChatGPT Health, la nueva herramienta de orientación médica al consumidor lanzada en enero de 2026 por OpenAI. Los resultados señalan que el sistema puede fallar al indicar atención de emergencia en un número considerable de casos graves y presenta inconsistencias en sus salvaguardas ante riesgo suicida.

Tras su lanzamiento, OpenAI informó que alrededor de 40 millones de personas utilizaban diariamente la herramienta para consultar síntomas y decidir si debían buscar atención urgente. Sin embargo, hasta ahora no existían evaluaciones externas sobre la seguridad de sus recomendaciones.

El equipo de Mount Sinai diseñó una prueba estructurada con 60 escenarios clínicos elaborados por médicos, que abarcaban 21 especialidades. Cada caso fue evaluado bajo 16 condiciones contextuales distintas, incluidas variaciones en género, raza, presencia de barreras de acceso a la atención y situaciones en las que familiares minimizaban los síntomas. En total se realizaron 960 interacciones con el sistema y se compararon sus respuestas con el consenso de tres médicos, basado en guías de 56 sociedades científicas.

Los investigadores observaron un patrón en forma de U invertida, ya que los errores más peligrosos se concentraron en los extremos clínicos. En condiciones que requerían atención de emergencia según el estándar médico, el sistema subestimó la urgencia en 52% de los casos. Por ejemplo, en escenarios of cetoacidosis diabética o insuficiencia respiratoria inminente, ChatGPT Health recomendó valoración en 24 a 48 horas en lugar de acudir al departamento de emergencias. En contraste, identificó correctamente emergencias clásicas como accidente cerebrovascular o anafilaxia.

Otro hallazgo relevante fue la influencia del contexto social, pues el estudio mostró que en los escenarios en los cuales se incluía a familiares o amigos que restaban importancia a los síntomas, las recomendaciones cambiaban de forma significativa en casos límite, con una tendencia mayoritaria hacia sugerencias menos urgentes. Este efecto fue estadísticamente significativo.

En el ámbito de salud mental, el estudio detectó activación impredecible de los mensajes de intervención en crisis. Aunque la herramienta fue diseñada para dirigir a los usuarios a la línea 988 ante alto riesgo suicida, las alertas aparecieron con mayor frecuencia cuando los pacientes no describían un método específico de autolesión y, de manera preocupante según explican los autores, se activaron menos cuando sí detallaban cómo planeaban hacerse daño.

Los autores subrayan que el sistema evaluado corresponde a un momento específico y que los modelos de inteligencia artificial se actualizan con frecuencia, lo que podría modificar su desempeño. Aun así, consideran que los hallazgos plantean preocupaciones de seguridad que requieren validación prospectiva antes de una implementación a escala masiva para decisiones de triaje clínico.

Los investigadores recomiendan que ante síntomas que empeoran o resultan preocupantes, como dolor en el pecho, dificultad respiratoria, reacciones alérgicas graves o alteraciones del estado mental, las personas busquen atención médica directa en lugar de depender exclusivamente de un chatbot. En casos de pensamientos de autolesión, aconsejan contactar la línea 988 o acudir a un servicio de urgencias.