La Organización Mundial de la Salud explica los seis principios de ética y gobernanza para la adopción de la inteligencia artificial en salud.

La Organización Mundial de la Salud (OMS) realizó un llamado a ejercer precaución en el uso de herramientas generadas por inteligencia artificial (IA) y modelos de lenguaje amplios (LLM, en inglés) para proteger y promover el bienestar humano, la seguridad humana, la autonomía y preservar la salud pública.

Los LLM incluyen algunas de las plataformas de expansión más rápida, como ChatGPT, Bard, Bert y otras, que imitan la comprensión, el procesamiento y la producción de la comunicación humana. Su difusión pública masiva y su creciente uso experimental para fines relacionados con la salud están generando una gran expectativa sobre sus potenciales usos en salud.

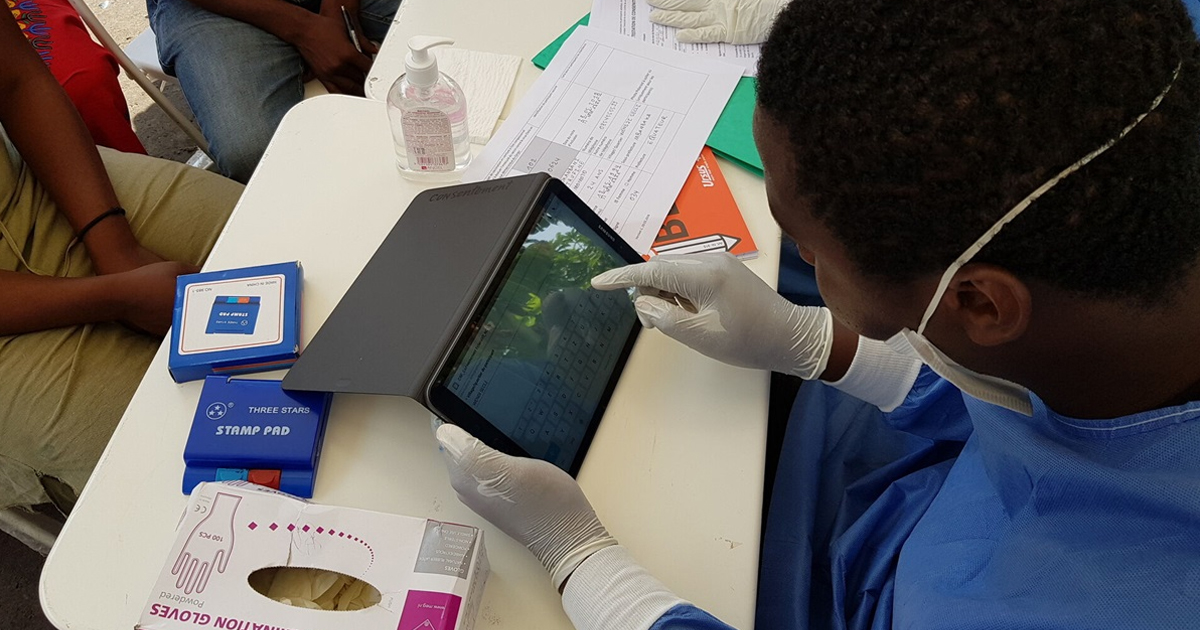

Por ello, la OMS advierte que es necesario examinar cuidadosamente los riesgos al utilizar LLM para mejorar el acceso a la información de salud, como herramienta de apoyo para la toma de decisiones o incluso para mejorar la capacidad de diagnósticos de enfermedades en entornos con recursos limitados, con el fin de proteger la salud de las personas y reducir brechas de desigualdad.

Existe un entusiasmo generalizado sobre el uso de estas tecnologías en diversas áreas como la informática, programación o educación, incluso la OMS reconoce su utilidad para apoyar a los profesionales de la salud, pacientes, investigadores y científicos. No obstante, también existe la preocupación de que no se ejerza la precaución que significa la adopción de una nueva alternativa tecnológica como lo son los LLM. Esto implica la importancia a los valores clave de transparencia, inclusión, participación pública, supervisión experta y evaluación rigurosa que propone la OMS.

La adopción precipitada de sistemas no probados podría llevar a errores por parte de los trabajadores de la salud y podría causar daño a los pacientes, por ello la OMS aboga por una adopción ética de estas herramientas para aprovechar de mejor manera sus beneficios a largo plazo.

Para ello es necesario supervisar rigurosamente el uso de tecnología, para que estas se utilicen de forma segura, eficaz y ética. Estas son algunas de las alertas que se deben tomas en cuenta según la OMS:

- Los datos utilizados para entrenar la IA pueden estar sesgados, generando información engañosa o inexacta que podría plantear riesgos para la salud, la equidad y la inclusión

- Los LLM generan respuestas que pueden parecer autorizadas y plausibles para un usuario final, sin embargo, estas respuestas pueden ser completamente incorrectas o contener errores graves, especialmente en el caso de las respuestas relacionadas con la salud.

- Los LLM pueden formarse con datos para los que no se haya dado previamente el consentimiento para su uso, y los LLM pueden no proteger los datos sensibles (incluidos los datos de salud) que un usuario proporciona a una aplicación para generar una respuesta.

- Los LLM pueden utilizarse indebidamente para generar y difundir desinformación muy convincente en forma de contenidos de texto, audio o vídeo que el público difícilmente puede diferenciar de contenidos sanitarios fiables.

- La OMS recomienda que los responsables políticos garanticen la seguridad y la protección de los pacientes mientras las empresas tecnológicas trabajan para comercializar los LLM.

De esta forma, la OMS ha identificado seis principios fundamentales de ética y gobernanza para la aplicación de la IA en salud: proteger la autonomía; promover el bienestar humano, la seguridad humana y el interés público; garantizar la transparencia, la explicabilidad y la inteligibilidad; fomentar la responsabilidad y la rendición de cuentas; garantizar la inclusión y la equidad; promover una IA que sea receptiva y sostenible.