El modelo híbrido MedFusionNet combina imágenes médicas y datos clínicos para apoyar diagnósticos más precisos y comprensibles.

Un avance reciente publicado en Communications Medicine presenta MedFusionNet, un modelo de inteligencia artificial (IA) diseñado para mejorar la clasificación y estratificación del riesgo en enfermedades complejas, como distintos tipos de cáncer. El estudio aborda uno de los principales retos de la medicina asistida por IA, la dificultad de interpretar imágenes médicas cuando coexisten múltiples hallazgos clínicos y cuando la información del paciente se encuentra dispersa en distintos formatos, como imágenes, textos y datos clínicos estructurados.

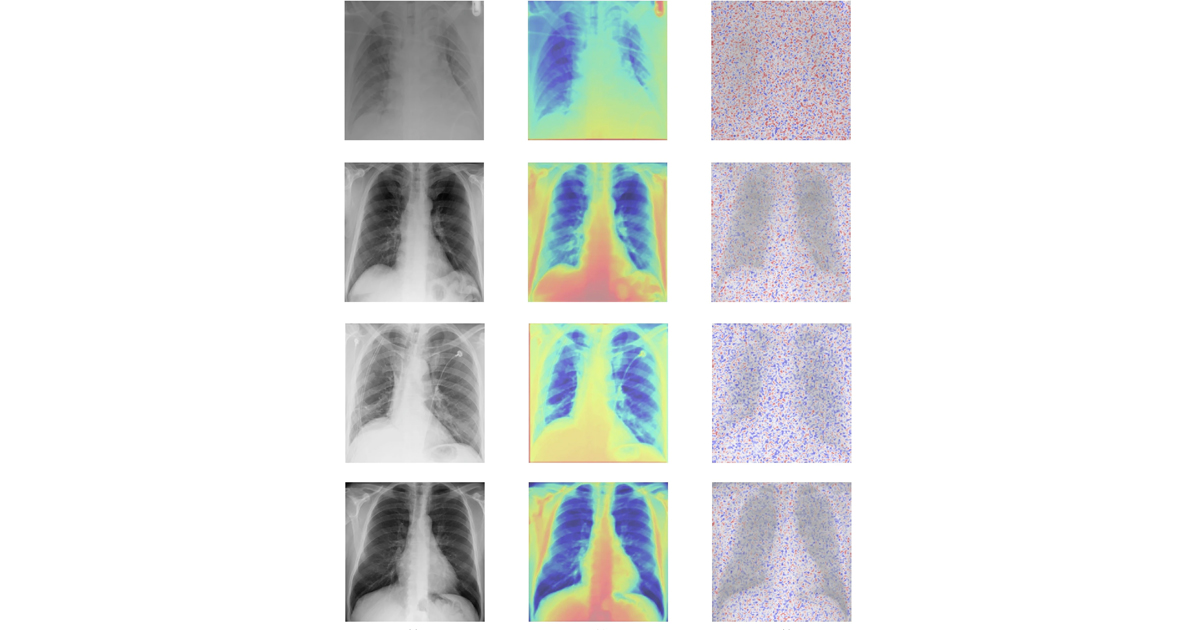

Además, a diferencia de los modelos tradicionales, que suelen analizar un solo diagnóstico a la vez, MedFusionNet está pensado para escenarios de clasificación multilabel o multietiqueta, en los que una misma imagen puede reflejar varias condiciones simultáneas. Este enfoque es relevante en áreas como la radiología, donde una radiografía de tórax puede mostrar signos de distintas patologías al mismo tiempo, o en la evaluación del riesgo de cáncer, que depende de múltiples factores biológicos y conductuales.

El modelo propuesto combina dos estrategias complementarias, en una primera etapa, aplica un sistema de umbrales univariados para identificar las características clínicas más relevantes asociadas a cada riesgo. En una segunda etapa, estas características se integran en una arquitectura de aprendizaje profundo híbrida que combina redes neuronales convolucionales y mecanismos de autoatención, lo que permite capturar relaciones complejas entre distintas señales clínicas e imágenes médicas.

Asimismo, MedFusionNet también incorpora información multimodal, ya que además de las imágenes, el sistema puede procesar datos clínicos y textos asociados al historial del paciente. Según los autores, esta fusión de fuentes permite detectar patrones que podrían pasar desapercibidos si cada tipo de información se analizara por separado, y al mismo tiempo mejora la interpretabilidad del modelo, un aspecto clave para su posible adopción en entornos clínicos.

Para evaluar su desempeño, los investigadores probaron el modelo en dos conjuntos de datos. Uno fue el conocido repositorio NIH ChestX-ray14, que incluye más de 112 mil radiografías de tórax con múltiples etiquetas diagnósticas. El otro fue un conjunto de datos clínicos sobre cáncer cervicouterino que integra variables demográficas, conductuales y médicas. En ambos casos, MedFusionNet mostró un rendimiento superior al de otros modelos de referencia, con mayor precisión y mayor estabilidad en la identificación de enfermedades poco frecuentes.

Los autores señalan que este tipo de herramientas podría contribuir a una detección más temprana de enfermedades, a una mejor priorización de pacientes según su nivel de riesgo y a una toma de decisiones clínicas más informada. Aunque subrayan que el modelo no sustituye el juicio médico, consideran que avances como MedFusionNet representan un paso importante hacia sistemas de apoyo clínico más fiables, transparentes y adaptados a la complejidad real de la práctica médica.