Un modelo trimodal desarrollado por investigadores de Meta es capaz de predecir la actividad cerebral con una precisión sin precedentes, abriendo una nueva era para la neurociencia.

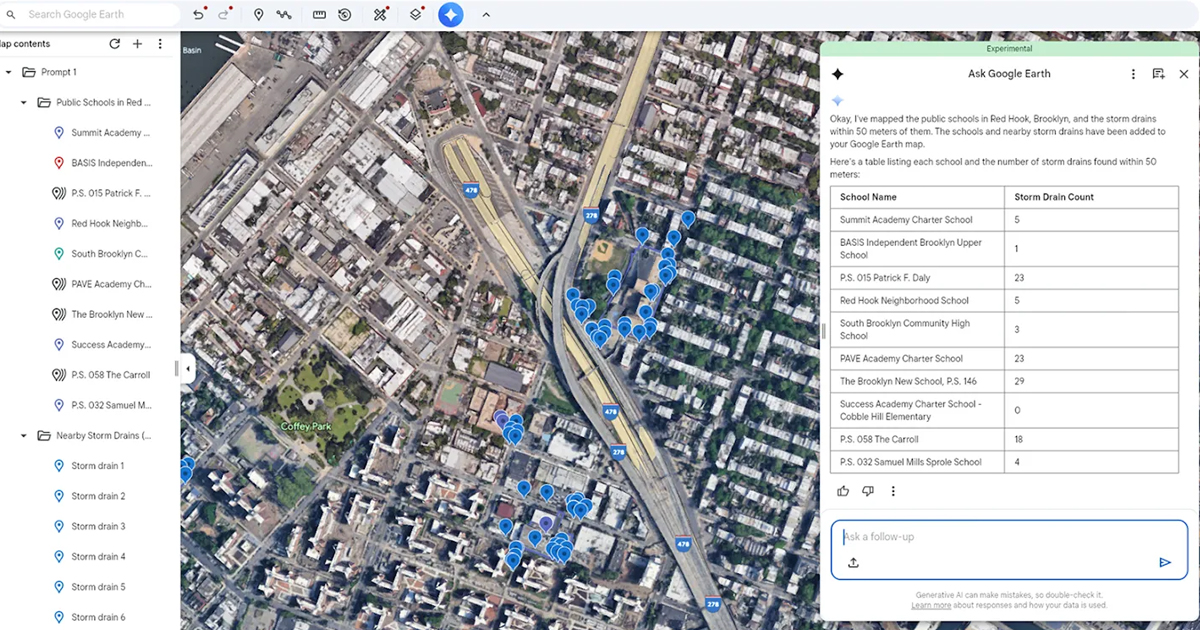

Un equipo de investigadores del laboratorio de inteligencia artificial de Meta (FAIR at Meta) publicó el 25 de marzo de 2026 un estudio que podría transformar la manera en que la ciencia estudia el cerebro humano. El modelo se llama TRIBE v2 y es capaz de predecir, con notable precisión, cómo responde el cerebro de una persona cuando ve una película, escucha un podcast o lee un texto, todo ello sin necesidad de realizarle un nuevo experimento en el laboratorio. En términos simples, se trata de una inteligencia artificial que ha aprendido a anticipar lo que el cerebro siente y procesa ante diferentes estímulos del mundo real. El estudio fue publicado en ArXiv.

Durante décadas, los neurocientíficos han estudiado el cerebro de manera fragmentada: un equipo investigaba cómo procesamos los rostros, otro cómo entendemos el lenguaje, otro cómo percibimos el movimiento. Cada grupo usaba sus propios experimentos, sus propios modelos, y sus propios datos. El resultado era una ciencia poderosa pero desarticulada, como un enorme rompecabezas al que le faltaba el marco.

TRIBE v2 propone una solución a ese problema: un único modelo de inteligencia artificial entrenado para predecir la actividad cerebral ante cualquier tipo de estímulo sensorial, ya sea visual, auditivo o lingüístico. Su nombre proviene de las tres modalidades que integra: video (video), audio (audio) e idioma (language, en inglés), de ahí las siglas TRI-B-E.

El modelo fue entrenado con más de mil horas de registros de resonancia magnética funcional (fMRI), una técnica que mide la actividad cerebral a través de los cambios en el flujo sanguíneo. Estos registros provienen de 720 personas distintas expuestas a películas, podcasts, videos y oraciones escritas en condiciones tanto naturales como experimentales de laboratorio.

Para hacer sus predicciones, TRIBE v2 combina tres modelos de inteligencia artificial previamente entrenados por separado: uno especializado en video (V-JEPA2, de Meta), uno en audio (Wav2Vec-Bert) y uno en lenguaje (Llama 3.2, también de Meta). Las representaciones de estos tres modelos se integran a través de un sistema de tipo transformador, la arquitectura que también impulsa los modelos de lenguaje como ChatGPT, con más de mil millones de parámetros aprendibles. En términos generales, el modelo “digiere” lo que una persona ve, oye y lee, y a partir de eso calcula cómo respondería su cerebro, región por región, con una resolución que cubre toda la corteza cerebral.

Uno de los hallazgos más importantes del estudio es que TRIBE v2 puede predecir la respuesta promedio de un grupo de personas ante un estímulo nuevo mejor de lo que lo haría cualquier individuo del grupo por sí solo. Esto significa que, en muchos casos, el modelo podría reemplazar o complementar costosos experimentos con participantes humanos.

El equipo demostró además que el modelo es capaz de replicar, de forma virtual, décadas de resultados establecidos por la neurociencia experimental. Por ejemplo, sin haber sido entrenado específicamente para ello, TRIBE v2 identificó correctamente que el cerebro activa el área fusiforme al ver rostros, el área parahipocampal al ver lugares, y las regiones del lenguaje al escuchar oraciones. Experimentos que tardaron años en establecerse en laboratorios de todo el mundo, el modelo los reproduce en cuestión de minutos de forma computacional.

Otra capacidad notable es la de adaptarse a personas nuevas con una cantidad muy pequeña de datos. Con apenas una hora de registros cerebrales de un individuo desconocido, el modelo puede ajustarse para predecir sus respuestas específicas con una precisión de dos a cuatro veces superior a la de los métodos tradicionales.

Más allá de la predicción, TRIBE v2 también aporta nueva información sobre cómo el cerebro humano combina lo que ve, oye y lee. Los investigadores encontraron que cada modalidad sensorial domina distintas regiones: el audio predomina cerca de la corteza auditiva, el video domina en las regiones visuales occipitales y parietales, y el lenguaje domina en las áreas de procesamiento semántico y grandes partes del lóbulo prefrontal.

Las mayores ganancias al combinar las tres modalidades se observaron en la unión temporo-parieto-occipital, una región conocida por su papel en la integración multisensorial, con incrementos de hasta un 50% en la precisión de las predicciones. Esto confirma de manera computacional algo que los neurocientíficos sospechaban: que el cerebro no procesa los sentidos por separado, sino que los fusiona activamente para construir una representación coherente del mundo.

Los propios autores reconocen que TRIBE v2 tiene fronteras importantes. La resonancia magnética funcional, por su naturaleza, no puede capturar los eventos que ocurren en milisegundos en el cerebro, por lo que el modelo opera con una resolución temporal limitada. Además, el modelo trata al cerebro como un observador pasivo de estímulos externos y no incorpora aún la dimensión activa del comportamiento humano: decisiones, movimientos, emociones complejas o interacciones sociales en tiempo real.

El modelo tampoco incluye modalidades sensoriales como el olfato, el tacto o el equilibrio, y fue desarrollado principalmente con participantes adultos y sanos, lo que limita su aplicabilidad directa a poblaciones clínicas, infantiles o de diversas condiciones neurológicas. Los investigadores señalan que integrar estas dimensiones es una de sus principales metas a futuro.

Otro aspecto relevante es que Meta ha publicado de forma abierta tanto el código como los pesos del modelo, accesibles a través de GitHub y Hugging Face respectivamente. También existe una demostración interactiva en línea donde cualquier persona puede explorar cómo el modelo predice la actividad cerebral ante diferentes estímulos visuales y auditivos.